Artık zaman öyle bir yere geldi ki sosyal medyada kaydırırken oturduğunuz yerden Trump size yatırım tavsiyesi verebilir, Kim Kardashian en gizli güzellik sırlarını fısıldayabilir. Neyden bahsettiğimi anlamadıysanız henüz sosyal medyanın çöplüğüne düşmemişsiniz demektir, tebrik ederim. Hemen açıklayayım: keşif sayfalarımız artık "AI mı, gerçek mi?" diye sormak zorunda kaldığımız videolarla dolup taşıyor.

"Gördüğüne inan" kuralı dijital çağda teknik olarak geçersiz hale geldi. Çünkü artık gördüğümüz şeyin kaynağı bir kamera değil, bir model olabilir. Deepfake teknolojisiyle görüntü ve ses, kayıt olmaktan çıkıp üretilebilir veri türüne dönüştü. Bu da temel bir soruyu zorunlu kılıyor: eğer her şey üretilebiliyorsa, "gerçek" neye dayanır?

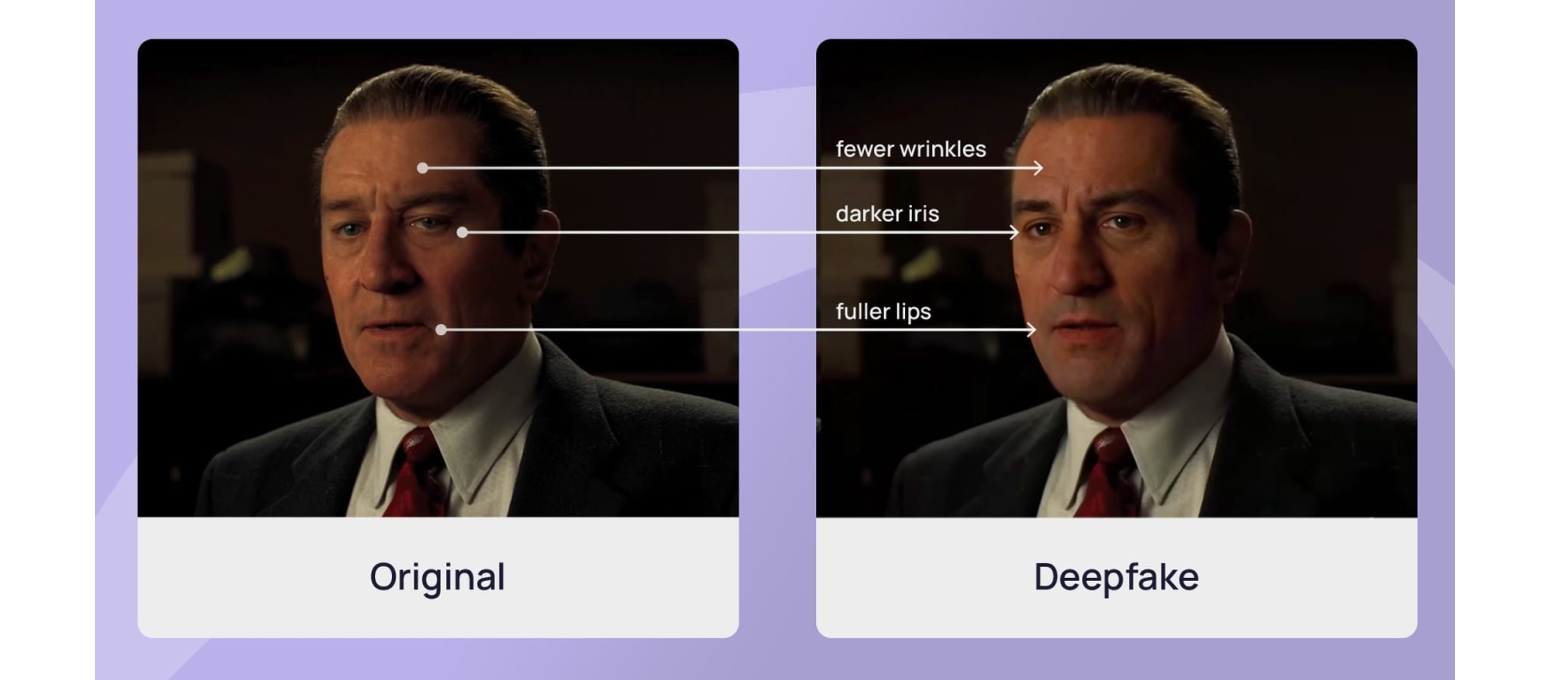

Deepfake sistemleri temelde birkaç ana teknolojinin birleşimidir: yüz eşleme ve landmark detection, görüntü sentezi, ses klonlama ve zaman serisi uyarlama. Bu sistemlerin en yaygın altyapısı generative adversarial network mimarisidir. Bir model içerik üretir, diğeri bunun gerçeğe ne kadar benzediğini değerlendirir. Bu rekabet zamanla son derece ikna edici sahte içerikler ortaya çıkarır.

İşte bu noktada kritik kırılma yaşanıyor: görsel doğruluk artık teknik bir özellik değil, istatistiksel bir benzerliktir. Eskiden video "kanıt"tı. Şimdi video sadece "olasılığı yüksek bir çıktı"dır.

Deepfake teknolojisi üç temel güveni yerle bir ediyor: görsel kanıta olan inancı, ses üzerinden kimlik doğrulamasını ve dijital içeriğin otoritesini. Bu yıkım karşısında doğrulama sisteminin de dönüşmesi kaçınılmaz hale geliyor. Metadata analizi, watermarking ve blockchain tabanlı içerik doğrulama bu yeni gerçekliğin araçları olarak öne çıkıyor.

Deepfake çağında gerçeklik kaybolmuyor, ama doğrulanabilirlik kayboluyor. Ve belki de en kritik gerçek şu: artık gerçek olan değil, en iyi üretilmiş olan görünür.