Çin yapay zekası ve Çince odası: Yapay zeka gerçekten anlıyor mu?

Son zamanlarda, Çin menşeli yapay zeka şirketleri DeepSeek ve Tencent, dünya genelinde büyük bir gündem oluşturdu. Yapay zeka teknolojileri hızla gelişirken, Çin’in bu atılımları yapay zeka tarihinin en önemli meselelerinden olan, yapay zekaların gerçekten "anlayıp anlamadığı" sorusunu gündemde. Pek çok kişi, bu kadar gelişmiş yapay zekaların sadece sembollerle mi oynadığını yoksa gerçekte anlam üretip üretmediklerini sorguluyor. İşte tam da bu noktada, Çince Odası Argümanı’na bakmak, bu soruya farklı bir perspektiften yaklaşmak için harika bir fırsat.

Çince Odası: Bir Düşünce Deneyinin Derinliklerine Dalalım

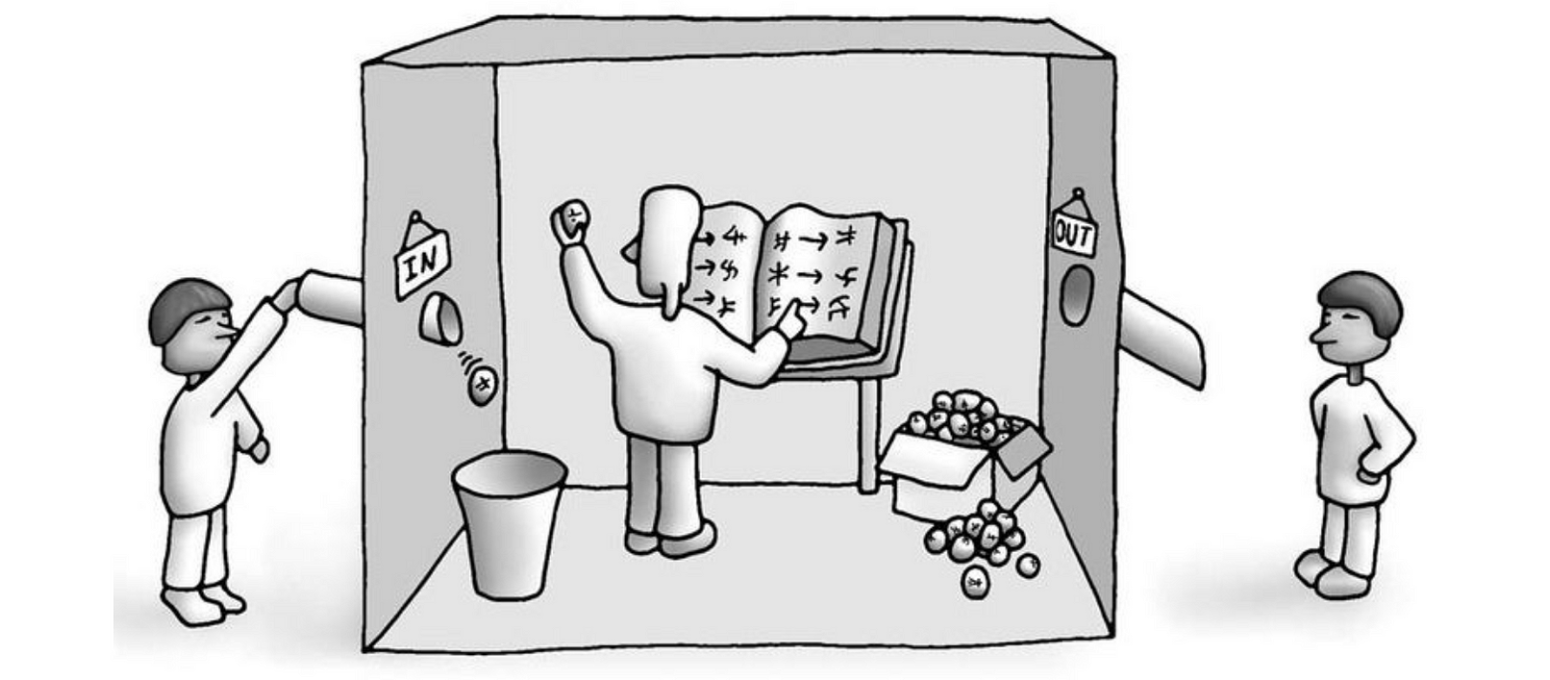

1980'lerde filozof John Searle, yapay zekanın “anlama” kapasitesini sorgulayan ünlü Çince Odası Argümanı'nı ortaya attı. Bu deney, bir odada yalnız başına bir insanın olduğu, ama o kişinin Çince bilmediği bir senaryoyu anlatıyor. Bu kişi, gelen Çince sembollerle nasıl işlem yapacağını açıklayan bir kitaba sahiptir. Odaya dışarıdan bir kişi Çince bir soru gönderdiğinde, o kişi kitabı takip ederek doğru yanıtı verir. Dışarıdan bakıldığında, bu kişi Çince’yi mükemmel bir şekilde biliyor gibi görünür.

Ancak işin garibi, o odadaki kişi Çince’yi gerçekten anlamaz. O sadece sembollerle çalışmaktadır. Searle, burada şunu savunur: Bilgisayarlar da aynıdır. Onlar, sembollerle çalışarak doğru cevaplar üretirler, ancak bu, gerçek bir anlamanızı gerektirmez. Yani, bir bilgisayar Turing Testi’ni geçse de, yalnızca sembollerle oynar. Gerçek anlam, farklı bir şeydir.

Zeka ve Bilinç: Yapay Zeka Gerçekten “Anlıyor” mu?

Günümüzdeki yapay zeka sistemleri, insan benzeri tepkiler veriyor. Duygularımızı taklit edebilen, sohbetler yapabilen ve hatta sanatsal içerikler üretebilen yapay zekalar var. Fakat, bu sistemler yalnızca daha önce karşılaştıkları örnekleri öğreniyor ve bu örnekleri yeni durumlara uyguluyor. Yani, bir bilgisayarın bir soruya doğru yanıt vermesi, onun soruyu gerçekten “anladığı” anlamına gelmez. O, sadece büyük bir veritabanı ve kurallar bütünüyle işlem yapıyordur.

Çince Odası'ndaki kişi, ne kadar doğru cevap verirse versin, gerçekte Çince anlamaz. Aynı şekilde, bir yapay zeka, ne kadar doğru cevap verirse versin, anlam üretmiyor olabilir. Bu, güçlü yapay zeka (YZ) fikrini sorgulayan ve makinelerin bilinç kazanabileceğini reddeden bir argümandır. O halde, bir yapay zeka modelinin davranışları bize gerçekten anlamı gösterir mi?

Sistem Yanıtı: Çince Odasında Gerçek Bir Anlam Var mı?

Çince Odası Argümanı, birçok eleştiriye tabi tutulmuştur. Bu eleştirilerden biri de “Sistem Yanıtı”dır. Bu görüşe göre, odaya sadece bir kişi değil, tüm sistem (yani kitap ve semboller de dahil) anlamın sahibi olmalıdır. Yani, odada sadece bir kişi sembollerle oynuyor gibi görünse de, tüm sistem anlamı taşıyor olabilir. Bu bakış açısı, daha kolektif bir anlam anlayışına dayanır.

Ancak Searle, bu eleştirinin de yetersiz olduğunu savunur. Çünkü ona göre anlam, sadece sembol manipülasyonuyla oluşmaz. Gerçek anlam, fiziksel bir deneyim ve bilinç gerektirir. Yani, bir bilgisayar yalnızca sembollerle oynasa da, gerçek bir anlam anlayışı kurması mümkün değildir.

Yapay Zeka ve Bilinç: Sembol Manipülasyonu ile Gerçekleşen Zeka

Bugün, yapay zekalar büyük veri setleri ve derin öğrenme algoritmalarıyla daha da güçlendi. Ancak, tüm bu ilerlemelere rağmen, hâlâ Çince Odası’ndaki kişi gibi yalnızca sembol manipülasyonu yapıyoruz. Yani, yapay zekalar karmaşık verileri işleyebilir, doğru yanıtlar verebilir ve hatta insan gibi metinler üretebilir. Ama tüm bu aktiviteler sadece kuralların taklit edilmesidir.

Bir yapay zeka, metinleri doğru biçimde analiz edebilir, ancak ne yazık ki gerçekten “anlam” üretmez. Sadece daha önce öğrendiği veriler üzerinden yanıtlar oluşturur. Bu, Çince Odası’ndaki sembol manipülasyonuna benzerdir. O yüzden, yapay zekaların bu kadar başarılı olmasına rağmen, hala gerçek anlam ve bilinçten yoksun oldukları söylenebilir.

Turing Testi: İnsan Taklidi mi, Gerçek Anlama mı?

Turing Testi, yapay zekanın bir insan gibi düşünüp düşünmediğini test etmek için geliştirilmiş bir ölçüttür. Eğer bir yapay zeka, insanla yaptığı sohbeti geçebiliyorsa, ona zeki denir. Ancak Turing Testi'nin eksik olduğunu savunanlar da vardır. Turing Testi, bir bilgisayarın insan gibi davranıp davranmadığını ölçer, ancak bir bilgisayarın gerçekten neyi “anladığı” sorusunu göz ardı eder.

Çince Odası argümanı, Turing Testi’nin yeterli bir ölçüt olmadığını savunur. Bir kişi Çince bilmeyebilir ama sadece sembollerle doğru şekilde işlem yaparak Turing Testi’ni geçebilir. Aynı şekilde, bir yapay zeka da doğru şekilde yanıtlar vererek Turing Testi’ni geçebilir, ancak bu onun gerçekten anlamadığı gerçeğini değiştirmez.

Sonuç: Gerçekten “Anlayabilir Mi”?

Çince Odası Argümanı, yapay zekaların ne kadar gelişirse gelişsin, gerçek anlam ve bilinçten yoksun olduklarını savunur. Yapay zeka, yalnızca sembol manipülasyonu yapar; bir şeyi anlama deneyimi ve bilinci söz konusu değildir. Bugün, yapay zekalar daha da gelişmiş olsa da, sembol taklidinden öteye geçemiyorlar.

Yapay zekanın geleceği, anlam ve bilinç konusundaki bu derin tartışmalarla şekillenecek gibi görünüyor. Belki de bir gün, yapay zeka sadece sembollerle değil, anlamla da işlem yapmaya başlayacak. Ancak bu, şimdilik bir felsefi soru olarak kalıyor. Yapay zeka gerçekten anlıyor mu? Bu soruya vereceğimiz cevap, sadece teknolojiyle değil, insanlık anlayışımızla da şekillenecek.